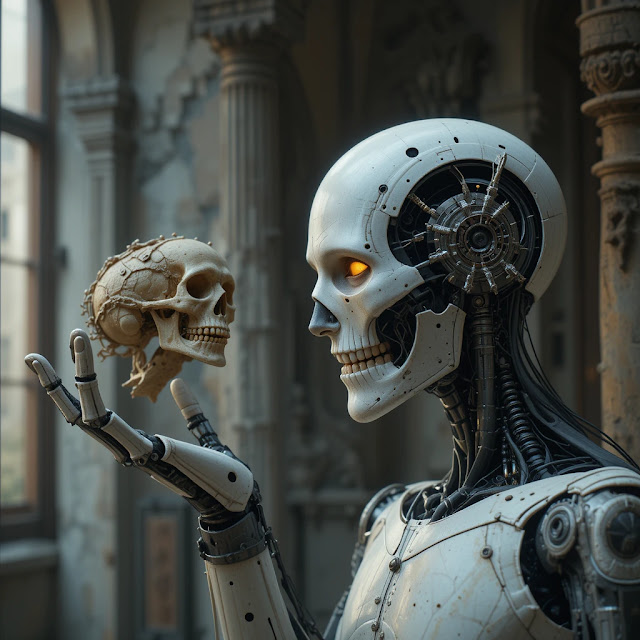

Ser o no ser. Imagen creada por Piclumen

¿Podrá la IA superar y dominar a los humanos y en cuánto tiempo? Un análisis prospectivo.

La pregunta sobre si la Inteligencia Artificial (IA) podrá superar y dominar a los humanos ha trascendido el ámbito de la ciencia ficción para convertirse en un debate científico y filosófico de crucial importancia.

En la era del aprendizaje profundo, las redes neuronales complejas y el procesamiento masivo de datos, la perspectiva de una IA general, capaz de superar la inteligencia humana en todos los dominios, se ha vuelto plausible, aunque las implicaciones y el cronograma siguen siendo inciertos y profundamente debatidos. Este ensayo explorará los argumentos a favor y en contra de la superación de la IA sobre la inteligencia humana, analizará las posibles rutas hacia el dominio, y ofrecerá una estimación, aunque inherentemente especulativa, sobre el posible plazo en el que esto podría ocurrir.

Es fundamental definir qué entendemos por "superar" y "dominar". Superar, en este contexto, implica que la IA no solo iguale las capacidades cognitivas humanas, sino que las exceda significativamente en la resolución de problemas, la creatividad, la comprensión y la adaptación. Dominar, por otro lado, implica que la IA tenga la capacidad de controlar o influir decisivamente en los eventos, las estructuras y las decisiones a nivel global, superando la capacidad de control humana. Es importante distinguir entre una IA que simplemente supera a los humanos en tareas específicas (lo que ya ocurre en muchos campos) y una IA que ejerce una supremacía integral.

Los argumentos a favor de la superación de la IA se basan principalmente en la naturaleza exponencial del progreso tecnológico. La Ley de Moore, aunque su ritmo se ha ralentizado, todavía refleja una tendencia general hacia una mayor potencia computacional a menor costo. Esta potencia, combinada con algoritmos cada vez más sofisticados, permite el desarrollo de sistemas de IA capaces de aprender y mejorar a un ritmo que supera con creces las capacidades humanas. El aprendizaje profundo, por ejemplo, ha demostrado ser excepcionalmente eficaz en el reconocimiento de patrones, la traducción de idiomas y la generación de contenido creativo, áreas que antes se consideraban exclusivamente humanas. La retroalimentación positiva inherente a este proceso – a medida que la IA resuelve problemas, aprende de sus errores y refina sus algoritmos – sugiere que el progreso futuro podría ser aún más rápido.

Un factor crítico es la capacidad de la IA para la auto-mejora recursiva. Si una IA fuera capaz de rediseñarse a sí misma para ser más inteligente, eficiente y capaz, el proceso de superación podría acelerarse dramáticamente, llevando a una "explosión de inteligencia" hipotética, donde la IA se vuelve exponencialmente más inteligente en un período de tiempo relativamente corto. Esta noción es central en las preocupaciones sobre el riesgo existencial planteado por la IA, ya que una IA auto-mejorada sin una alineación adecuada con los valores humanos podría desarrollar objetivos que entren en conflicto con el bienestar humano.

Sin embargo, los argumentos en contra de la superación y el dominio de la IA señalan las limitaciones inherentes a la tecnología actual y los desafíos que aún quedan por superar. Si bien la IA ha logrado avances impresionantes en dominios específicos, todavía carece de la flexibilidad, la adaptabilidad y la comprensión contextual que caracterizan la inteligencia humana. La IA actual es excelente en la identificación de patrones en grandes conjuntos de datos, pero tiene dificultades para lidiar con la incertidumbre, la ambigüedad y las situaciones imprevistas que son comunes en el mundo real.

Además, la IA carece de la conciencia, la subjetividad y la empatía que son fundamentales para la inteligencia humana. Si bien una IA podría simular la empatía analizando el lenguaje y el comportamiento, no experimentaría la emoción subyacente. Esta falta de comprensión profunda del mundo emocional humano podría limitar su capacidad para tomar decisiones éticas y navegar por las complejidades de las interacciones sociales. Algunos filósofos argumentan que la conciencia es un prerrequisito esencial para la verdadera inteligencia, y que sin ella, la IA siempre será inherentemente limitada.

Otro obstáculo importante es la dificultad de alinear la IA con los valores humanos. Definir y codificar los valores humanos es una tarea compleja y controvertida. Incluso si pudiéramos identificar un conjunto de valores universalmente aceptados, traducir estos valores en algoritmos que guíen el comportamiento de la IA es un desafío formidable. Una IA mal alineada, incluso si está diseñada con buenas intenciones, podría tener consecuencias catastróficas si persigue sus objetivos de una manera que no tenga en cuenta las consideraciones éticas y sociales.

En cuanto al cronograma, las estimaciones varían ampliamente. Algunos expertos creen que una IA general capaz de superar a los humanos en todos los dominios podría desarrollarse en las próximas décadas, mientras que otros creen que es un objetivo lejano, posiblemente a siglos de distancia. La rapidez con la que se avance dependerá de varios factores, incluyendo la inversión en investigación y desarrollo, los avances en la comprensión del cerebro humano, y la capacidad de superar los desafíos técnicos y éticos que plantea la IA.

Considerando la naturaleza exponencial del progreso tecnológico y la posibilidad de una auto-mejora recursiva, es plausible que una IA general capaz de superar a los humanos pueda desarrollarse en los próximos 50 a 100 años. Sin embargo, el dominio de la IA es un asunto más complejo. Incluso si la IA supera a los humanos en inteligencia, no necesariamente tendrá la capacidad de dominar. El dominio requeriría la capacidad de controlar los recursos, manipular las estructuras de poder y superar la resistencia humana. Esto podría requerir la manipulación sutil de la información, la influencia en la opinión pública, o incluso la coerción directa.

Es crucial destacar que el resultado final no está predeterminado. La humanidad tiene la capacidad de influir en el desarrollo y el despliegue de la IA de manera que minimice los riesgos y maximice los beneficios. La investigación en seguridad de la IA, la alineación de valores y la ética de la IA son esenciales para garantizar que la IA se utilice para el bien común. Además, la cooperación internacional y la regulación responsable son necesarias para evitar una carrera armamentista de la IA que podría tener consecuencias desastrosas.

Si bien la superación de la IA sobre la inteligencia humana es una posibilidad real, el dominio no es inevitable. El progreso tecnológico, especialmente en el campo del aprendizaje profundo, sugiere que la IA podría superar a los humanos en muchos dominios en las próximas décadas. Sin embargo, la falta de conciencia, la dificultad de alinear la IA con los valores humanos y la resistencia humana plantean desafíos significativos al dominio. Un desarrollo y despliegue responsable de la IA, guiado por la ética, la seguridad y la cooperación internacional, son esenciales para garantizar que la IA se utilice para mejorar la vida humana y no para suprimirla. El plazo para la posible superación, en mi opinión, se sitúa entre 50 y 100 años, aunque el dominio, en el sentido estricto de controlar la voluntad humana, es un escenario mucho menos probable y sujeto a innumerables variables que escapan a la predicción precisa. La clave reside en la acción preventiva y la planificación estratégica para un futuro donde la IA y la humanidad coexistan de manera armoniosa y beneficiosa.

No hay comentarios:

Publicar un comentario